Una interfaz cerebro-máquina de última generación creada por neurocientíficos de la Universidad de Californica San Francisco puede generar un discurso sintético de sonido natural mediante el uso de la actividad cerebral para controlar un tracto vocal virtual: una simulación por computadora anatómicamente detallada que incluye los labios, la mandíbula, la lengua y la laringe. El estudio se realizó en participantes de investigación con habla intacta, pero la tecnología podría algún día restaurar las voces de las personas que han perdido la capacidad de hablar debido a la parálisis y otras formas de daño neurológico.

Speech synthesis from neural decoding of spoken sentences.

El accidente cerebrovascular, la lesión cerebral traumática y las enfermedades neurodegenerativas como la enfermedad de Parkinson, la esclerosis múltiple y la esclerosis lateral amiotrófica (ELA o enfermedad de Lou Gehrig) a menudo causan una pérdida irreversible de la capacidad para hablar. Algunas personas con discapacidades del habla severas aprenden a deletrear sus pensamientos letra por letra utilizando dispositivos de asistencia que rastrean movimientos oculares muy pequeños o músculos faciales. Sin embargo, producir texto o voz sintetizada con tales dispositivos es laborioso, propenso a errores y dolorosamente lento, generalmente permitiendo un máximo de 10 palabras por minuto, en comparación con las 100 a 150 palabras por minuto de voz natural.

El nuevo sistema que se está desarrollando en el laboratorio de Edward Chang demuestra que es posible crear una versión sintetizada de la voz de una persona que puede controlarse mediante la actividad de los centros del habla de su cerebro. En el futuro, este enfoque podría no solo restaurar la comunicación fluida a personas con discapacidades del habla severas, dicen los autores, sino que también podría reproducir parte de la musicalidad de la voz humana que transmite las emociones y la personalidad del hablante.

“Por primera vez, este estudio demuestra que podemos generar oraciones habladas completas basadas en la actividad cerebral de un individuo”, dijo  Chang, profesor de cirugía neurológica y miembro del Instituto de Neurociencia Weill de la UCSF. “Esta es una prueba de que con la tecnología que ya está a nuestro alcance, deberíamos poder construir un dispositivo que sea clínicamente viable en pacientes con pérdida del habla”, añadió.

Chang, profesor de cirugía neurológica y miembro del Instituto de Neurociencia Weill de la UCSF. “Esta es una prueba de que con la tecnología que ya está a nuestro alcance, deberíamos poder construir un dispositivo que sea clínicamente viable en pacientes con pérdida del habla”, añadió.

La investigación fue dirigida por Gopala Anumanchipalli, científico del habla, y Josh Chartier, un estudiante graduado en bioingeniería en el laboratorio Chang. Se basa en un estudio reciente en el que la pareja describió por primera vez cómo los centros del habla del cerebro humano coreografían los movimientos de los labios, la mandíbula, la lengua y otros componentes del tracto vocal para producir un habla fluida.

A partir de ese trabajo, Anumanchipalli y Chartier se dieron cuenta de que los intentos anteriores para decodificar directamente el habla a partir de la actividad cerebral podrían haber tenido un éxito limitado debido a que estas regiones del cerebro no representan directamente las propiedades acústicas de los sonidos del habla, sino las instrucciones necesarias para coordinar los movimientos del cerebro.

Boca y garganta durante el habla

“La relación entre los movimientos del tracto vocal y los sonidos del habla que se producen es complicada”, dijo Anumanchipalli. “Razonamos que si estos centros de habla en el cerebro codifican movimientos en lugar de sonidos, deberíamos intentar hacer lo mismo para decodificar esas señales”.

En su nuevo estudio, Anumancipali y Chartier pidieron a cinco voluntarios que estaban siendo tratados en el Centro de Epilepsia de la UCSF (pacientes con habla intacta a los que se les habían implantado temporalmente electrodos en el cerebro para mapear la fuente de sus ataques en preparación para la neurocirugía) que leyeran varios cientos de oraciones en voz alta y registraron la actividad de una región del cerebro que se sabe está involucrada en la producción del lenguaje.

Basados ??en las grabaciones de audio de las voces de los participantes, los investigadores utilizaron principios lingüísticos para aplicar técnicas de ingeniería inversa a los movimientos del tracto vocal necesarios para producir esos sonidos: juntar los labios aquí, apretar las cuerdas vocales, mover la punta de la lengua al techo del boca, luego relajarla, y así sucesivamente.

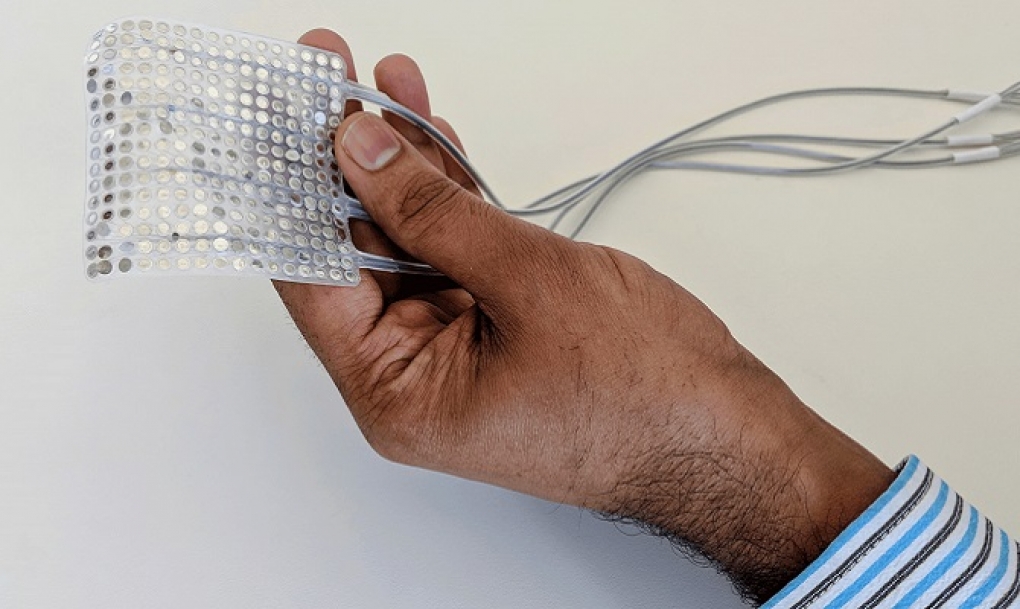

Este mapeo detallado del sonido a la anatomía permitió a los científicos crear un tracto vocal virtual realista para cada participante que podría ser  controlado por su actividad cerebral. Esto comprendía dos algoritmos de aprendizaje automático de “red neuronal”: un decodificador que transforma los patrones de actividad cerebral producidos durante el habla en movimientos del tracto vocal virtual, y un sintetizador que convierte estos movimientos del tracto vocal en una aproximación sintética de la voz del participante.

controlado por su actividad cerebral. Esto comprendía dos algoritmos de aprendizaje automático de “red neuronal”: un decodificador que transforma los patrones de actividad cerebral producidos durante el habla en movimientos del tracto vocal virtual, y un sintetizador que convierte estos movimientos del tracto vocal en una aproximación sintética de la voz del participante.

Actualmente, los investigadores están experimentando con matrices de electrodos de mayor densidad y algoritmos de aprendizaje automático más avanzados que esperan que mejoren aún más el habla sintetizada. La siguiente prueba importante para la tecnología es determinar si alguien que no puede hablar podría aprender a usar el sistema sin poder entrenarlo con su propia voz y hacer que se generalice a cualquier cosa que desee decir.

“Las personas que no pueden mover sus brazos y piernas han aprendido a controlar las extremidades robóticas con sus cerebros”, dijo Chartier. “Tenemos la esperanza de que un día las personas con discapacidades del habla puedan aprender a hablar nuevamente utilizando este tracto vocal artificial controlado por el cerebro”.

Anumanchipalli agregó: “Estoy orgulloso de haber podido reunir la experiencia de neurociencia, lingüística y aprendizaje automático como parte de este importante hito para ayudar a los pacientes con discapacidad neurológica”.

Recordamos que SALUD A DIARIO es un medio de comunicación que difunde información de carácter general relacionada con distintos ámbitos sociosanitarios, por lo que NO RESPONDEMOS a consultas concretas sobre casos médicos o asistenciales particulares. Las noticias que publicamos no sustituyen a la información, el diagnóstico y/o tratamiento o a las recomendaciones QUE DEBE FACILITAR UN PROFESIONAL SANITARIO ante una situación asistencial determinada.

SALUD A DIARIO se reserva el derecho de no publicar o de suprimir todos aquellos comentarios contrarios a las leyes españolas o que resulten injuriantes, así como los que vulneren el respeto a la dignidad de la persona o sean discriminatorios. No se publicarán datos de contacto privados ni serán aprobados comentarios que contengan 'spam', mensajes publicitarios o enlaces incluidos por el autor con intención comercial.

En cualquier caso, SALUD A DIARIO no se hace responsable de las opiniones vertidas por los usuarios a través de los canales de participación establecidos, y se reserva el derecho de eliminar sin previo aviso cualquier contenido generado en los espacios de participación que considere fuera de tema o inapropiados para su publicación.

* Campos obligatorios