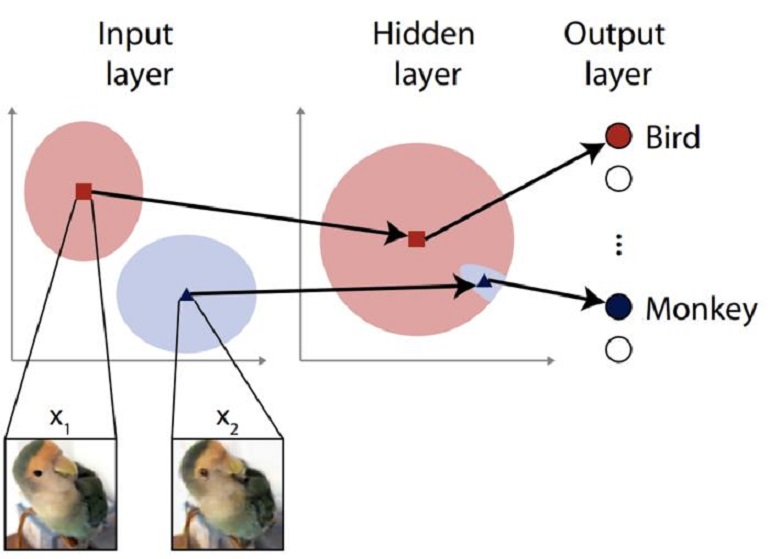

La mayoría de los sistemas de inteligencia artificial se basan en redes neuronales, algoritmos inspirados en neuronas biológicas que se encuentran en el cerebro. Estas redes pueden constar de varias capas, con entradas que entran por un lado y salidas por el otro.

Las salidas se pueden utilizar para tomar decisiones automáticas, por ejemplo, en coches sin conductor. Los ataques para engañar a una red neuronal pueden implicar la explotación de vulnerabilidades en las capas de entrada, pero normalmente solo se considera la capa de entrada inicial al diseñar una defensa. Por primera vez, los investigadores aumentaron las capas internas de una red neuronal con un proceso que involucra ruido aleatorio para mejorar su resiliencia.

La inteligencia artificial (IA) se ha convertido en algo relativamente común. Es probable que tengas un teléfono inteligente con un asistente de IA o que utilices un motor de búsqueda impulsado por IA. Si bien es un término amplio que puede incluir muchas formas diferentes de procesar información y, a veces, tomar decisiones, los sistemas de IA a menudo se construyen utilizando redes neuronales artificiales (RNA) análogas a las del cerebro. Y al igual que el cerebro, las RNA a veces pueden confundirse, ya sea por accidente o por acciones deliberadas de un tercero. Piensa en algo así como una ilusión óptica: podría hacerte sentir como si estuvieras mirando una cosa cuando en realidad estás mirando otra.

Sin embargo, la diferencia entre las cosas que confunden a una RNA y las que podrían confundirnos a nosotros es que alguna información visual podría parecer perfectamente normal, o al menos podría ser comprensible para nosotros, pero, no obstante, una RNA puede interpretarla como algo completamente diferente.

¿Gato o perro?

Un ejemplo trivial podría ser un sistema de clasificación de imágenes que confunde a un gato con un perro, pero un ejemplo más serio podría ser un automóvil sin conductor que confunde una señal de alto con una señal de derecho de paso. Y no se trata sólo del ya controvertido ejemplo de los coches sin conductor; existen sistemas de diagnóstico médico y muchas otras aplicaciones sensibles que reciben información e informan, o incluso toman, decisiones que pueden afectar a las personas.

Como las entradas no son necesariamente visuales, no siempre es fácil analizar por qué un sistema podría haber cometido un error de un vistazo. Los atacantes que intentan perturbar un sistema basado en RNA pueden aprovechar esto, alterando sutilmente un patrón de entrada anticipado para que sea malinterpretado y el sistema se comporte de manera incorrecta, tal vez incluso problemática. Existen algunas técnicas de defensa para ataques como estos, pero tienen limitaciones.

Jumpei Ukita, recién graduado, y el profesor Kenichi Ohki, del Departamento de Fisiología de la Facultad de Medicina de la Universidad de Tokio, idearon y probaron una nueva forma de mejorar la defensa de las RNA.

Redes neuronales

“Las redes neuronales suelen constar de capas de neuronas virtuales. Las primeras capas a menudo serán responsables de analizar las entradas identificando los elementos que corresponden a una determinada entrada”, dijo Ohki. “Un atacante podría proporcionar una imagen con artefactos que engañen a la red para que la clasifique erróneamente. Una defensa típica para un ataque de este tipo podría ser introducir deliberadamente algo de ruido en esta primera capa. Parece contradictorio que pueda ayudar, pero al hacerlo, permite mayores adaptaciones a una escena visual u otro conjunto de entradas. Sin embargo, este método no siempre es tan efectivo y pensamos que podríamos mejorar el asunto mirando más allá de la capa de entrada hacia el interior de la red”.

Ukita y Ohki no son sólo informáticos. También estudiaron el cerebro humano, y esto los inspiró a utilizar un fenómeno que en un RNA. Esto fue para agregar ruido no solo a la capa de entrada, sino también a las capas más profundas. Por lo general, esto se evita porque se teme que afecte la efectividad de la red en condiciones normales. Pero el dúo descubrió que este no era el caso y, en cambio, el ruido promovió una mayor adaptabilidad en su RNA de prueba, lo que redujo su susceptibilidad a ataques adversarios simulados.

Ataque y defensa

“Nuestro primer paso fue idear un método hipotético de ataque que ataque más profundamente que la capa de entrada. Un ataque de este tipo tendría que resistir la resiliencia de una red con una defensa contra el ruido estándar en su capa de entrada. A estos los llamamos ejemplos adversarios del espacio de características”, dijo Ukita. “Estos ataques funcionan proporcionando una entrada intencionalmente alejada, en lugar de cerca, de la entrada que una RNA puede clasificar correctamente. Pero el truco consiste en presentar artefactos sutilmente engañosos a las capas más profundas. Una vez que demostramos el peligro de tal ataque, inyectamos ruido aleatorio en las capas ocultas más profundas de la red para aumentar su adaptabilidad y, por lo tanto, su capacidad defensiva. Nos complace informar que funciona”.

Si bien la nueva idea resulta sólida, el equipo desea desarrollarla aún más para hacerla aún más efectiva contra ataques anticipados, así como contra otros tipos de ataques contra los que aún no la han probado. Actualmente, la defensa sólo funciona en este tipo específico de ataque.

“Los futuros atacantes podrían intentar considerar ataques que puedan escapar del ruido del espacio de características que consideramos en esta investigación”, dijo Ukita. “Efectivamente, ataque y defensa son dos caras de la misma moneda; Es una carrera armamentista de la que ninguna de las partes retrocederá, por lo que debemos iterar, mejorar e innovar continuamente con nuevas ideas para proteger los sistemas que utilizamos todos los días”.

Artículo de referencia:

Jumpei Ukita y Kenichi Ohki. Ataques y defensas adversarios utilizando la estocasticidad del espacio de características. Neural Networks , DOI: 10.1016/j.neunet.2023.08.022

Recordamos que SALUD A DIARIO es un medio de comunicación que difunde información de carácter general relacionada con distintos ámbitos sociosanitarios, por lo que NO RESPONDEMOS a consultas concretas sobre casos médicos o asistenciales particulares. Las noticias que publicamos no sustituyen a la información, el diagnóstico y/o tratamiento o a las recomendaciones QUE DEBE FACILITAR UN PROFESIONAL SANITARIO ante una situación asistencial determinada.

SALUD A DIARIO se reserva el derecho de no publicar o de suprimir todos aquellos comentarios contrarios a las leyes españolas o que resulten injuriantes, así como los que vulneren el respeto a la dignidad de la persona o sean discriminatorios. No se publicarán datos de contacto privados ni serán aprobados comentarios que contengan 'spam', mensajes publicitarios o enlaces incluidos por el autor con intención comercial.

En cualquier caso, SALUD A DIARIO no se hace responsable de las opiniones vertidas por los usuarios a través de los canales de participación establecidos, y se reserva el derecho de eliminar sin previo aviso cualquier contenido generado en los espacios de participación que considere fuera de tema o inapropiados para su publicación.

* Campos obligatorios